Ejemplo de ello es el caso de un usuario que se ha viralizado en los últimos días, quien compartió la imagen de una familia en una infravivienda para denunciar las condiciones de algunos españoles en el franquismo.

Otro internauta tomó su mensaje y pidió a Grok información sobre la imagen, a lo que la inteligencia artificial respondió que mostraba a una familia de aparceros en Alabama, en Estados Unidos y que, por tanto, no fue tomada durante el franquismo.

Lea más: Musk dice que lanzará Grok 5 este año y que su versión actual es mejor que GPT-5 de OpenAI

La respuesta de Grok provocó una retahíla de insultos y descalificaciones contra el usuario que ubicó la imagen en España, pese a que una simple búsqueda con Google Lens demuestra que, efectivamente, la fotografía se realizó en una vivienda de Málaga en 1953, tal y como reveló una historiadora en un hilo de X.

Esta usuaria solicitó a Grok que revisara sus respuestas tras darle las fuentes originales de la fotografía. Sin embargo, la herramienta se reafirmaba en su error, atribuyendo la imagen a Estados Unidos.

Hola @grok indica más o menos año de la foto, país, autor, etc. Gracias https://t.co/ndt9RET6wf

— Fachar (@FACHARTRUMPUTIN) August 23, 2025

Tras varios intentos, no fue hasta que la internauta comparó en un mismo tuit la imagen de la España franquista con la que Grok había identificado -visiblemente distintas-, que la IA de X reconoció su error.

Aunque tardó más de dos horas en hacerlo y ese post apenas tuvo visualizaciones, por los millones de vistas que tuvo la que provocó la polémica con un dato falso.

“Los chatbots basados en IA buscan generar un texto convincente, bien estructurado, y que sea cierto o verdadero no importa”, explica a EFE Verifica Javi Cantón, profesor e investigador en la Universidad Internacional de La Rioja, y experto en IA y desinformación.

Sepa más: Mensajes antisemitas de Grok obligan a la IA de Musk a borrar publicaciones

Cantón señala que estas herramientas no saben “contrastar hechos en tiempo real ni aplican criterios periodísticos de verificación”. “No entienden lo que afirman. En definitiva, generan plausibilidad lingüística, no verdad factual”, subraya.

A las limitaciones propias de estas herramientas se suman “los sesgos ideológicos y la eliminación de límites poco éticos que se han incluido en su programación”, agrega.

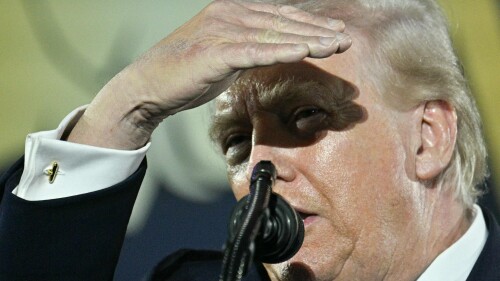

Según una investigación de Business Insider, Grok fue entrenado con “prompts” (instrucciones que se le dan a un sistema de IA para guiar su respuesta) cuyo objetivo es convertir esta herramienta en una alternativa a lo que Elon Musk considera los “chatbots wokes”, como ChatGPT.

Extrabajadores de xAI, la compañía de Musk, dijeron a Business Insider que, en su opinión, los métodos para entrenar a Grok “parecían dar mucha prioridad a las creencias de la derecha”.

Alta tasa de error en sus respuestas

Una investigación publicada por la revista Columbia Journalism Review evaluó la capacidad de ocho herramientas de inteligencia artificial para acceder, presentar y citar las noticias que utilizaban como fuente.

El estudio concluyó que estos chatbots por lo general “no sabían rechazar las preguntas que no podían responder con precisión, y en su lugar ofrecían respuestas incorrectas o especulativas”. De hecho, la inteligencia artificial de X respondió incorrectamente al 94 % de las preguntas que le plantearon los investigadores.

Entérese más: Microsoft anuncia acuerdo con Elon Musk para albergar su chatbot de IA

En su página web, la compañía de Musk advierte de que, debido a que “Grok ha sido entrenado con información disponible públicamente”, sus respuestas pueden incluir en ocasiones “información engañosa o inexacta”.

Hace unas semanas, el periódico El País difundió una fotografía del escritor y académico Antonio Muñoz Molina para ilustrar una entrevista. Un usuario le preguntó a Grok la marca y el precio del reloj que Molina llevaba en la imagen, a lo que la inteligencia artificial respondió: “El reloj que lleva Antonio Muñoz Molina en la foto es un Rolex Datejust 36 mm con esfera blanca, bisel estriado y brazalete Jubilee. Precio aproximado: 10.000-15.000 €".

En realidad, el reloj era un Festina, pero, como ocurrió con la vetusta fotografía de Málaga, la consulta a Grok —ahora eliminada, pero que llegó a acumular casi 700.000 visualizaciones— originó una avalancha de insultos contra el escritor.

Estas herramientas están hechas “para darnos la razón y adularnos”, por lo que “no podemos fiarnos al 100 % de lo que nos dicen”, advierte Javier Cantón.

Es por ello, explica, que el uso de chatbots para verificar contenidos puede “contribuir a reforzar las cámaras de eco”.

Fuente: EFE.